O designer que só sabe fazer ecrãs bonitos tem os dias contados. Não porque o craft seja irrelevante (não é), mas porque o craft sozinho, sem pensamento sistémico, sem capacidade de definir constraints, sem literacia de IA, é insuficiente para os produtos que já estão a ser construídos.

Se trabalhas em Product Design, já ouviste a frase: "o futuro não é desenhar ecrãs." Parece provocador. Parece vago. E, honestamente, parece o tipo de coisa que se diz numa palestra para gerar aplausos sem dar respostas.

Mas desta vez, a ideia tem substância. Nos últimos dois anos, a discussão sobre generative UI, Agentes de IA, outcome-oriented design ganhou forma concreta. E em março de 2026, surgiu um dos primeiros exemplos reais de GenUI a funcionar no terreno. O mais surpreendente? O exemplo mais entusiasmante não é um layout gerado por IA. São checkboxes.

Vamos desmontar isto. Sem buzzwords, sem futurismo oco. Vamos falar do que está a acontecer, do que muda para ti como designer, e do que podes começar a fazer hoje.

O ecrã que desenhas é o mesmo para toda a gente (e isso é o problema)

Quando desenhas uma interface (um fluxo de reserva de voo, uma página de produto, um dashboard), estás a fazer um compromisso. Tentas satisfazer o máximo de pessoas possível com um único layout. Sabes que não vais agradar a ninguém a 100%, mas não tens alternativa. Personalização e customização ajudam, mas de formas limitadas.

Este modelo tem funcionado durante 40 anos. Desde o Macintosh em 1984, o paradigma dominante tem sido o da interface gráfica: o utilizador dá comandos ao computador (clica, arrasta, preenche) e o computador executa. É o segundo paradigma de interação (o primeiro foi a linha de comandos)¹.

Com a inteligência artificial generativa, surge um terceiro paradigma: o utilizador diz ao sistema o resultado que quer, não os passos para lá chegar. Chama-se intent-based outcome specification². Não é "clica aqui, filtra ali, ordena por preço." É: "encontra-me um voo barato para Paris na primeira semana de maio, sem escalas e com lugar à janela."

E é aqui que entra a generative UI e os agentes de IA.

O que é generative UI (e o que não é)

Generative UI, ou GenUI, é uma interface gerada em tempo real por inteligência artificial, personalizada para o contexto e necessidades de cada utilizador individual. Não é a mesma coisa que usar IA para desenhar interfaces mais rápido (isso é AI-assisted design, e é outra conversa).

A diferença é quem beneficia e quando. No AI-assisted design, a IA ajuda a equipa de design durante o desenvolvimento, mas o utilizador final encontra uma interface tradicional, estática. Na GenUI, a IA gera elementos da interface em tempo real, e a experiência do utilizador final é que está a ser moldada³.

Atenção: GenUI não significa que a IA vai desenhar layouts completos do zero. Pelo menos, não por agora. O que está a acontecer na prática é mais interessante, e mais subtil, do que isso, como veremos a seguir.

Checkboxes: o exemplo mais entusiasmante de GenUI (a sério)

Em março de 2026, surgiu um artigo cujo título parece uma piada: "The Most Exciting Development in GenUI: Buttons and Checkboxes."⁴ Não é piada. É o ponto de viragem.

O exemplo é o Google AI Mode. Um utilizador pesquisa hotéis em Londres. O sistema devolve recomendações formatadas com imagens, preços, avaliações, e checkboxes ao lado de cada hotel. O utilizador seleciona dois hotéis, e esses nomes são automaticamente inseridos no campo de conversa, prontos para perguntas de seguimento.

Parece simples. Mas pensa no que acontece sem estas checkboxes: o utilizador teria de ler os nomes dos hotéis, memorizá-los, e escrevê-los manualmente no chat. Cada passo é fricção. Cada passo é uma oportunidade para o utilizador desistir ou cometer um erro.

O segundo exemplo é o Claude, da Anthropic, que por vezes gera um módulo interativo de perguntas de escolha múltipla, para recolher contexto antes de dar uma resposta. O sistema decide que precisa de saber o orçamento, as datas, quem viaja. Em vez de pedir ao utilizador que escreva tudo isso em texto livre, apresenta perguntas com opções clicáveis, uma de cada vez.

Compara isto com a alternativa do Perplexity, que faz cinco perguntas de seguimento em texto puro. Para responder, o utilizador tem de escrever as respostas uma a uma, saltar entre o campo de texto e as perguntas, e lembrar-se de numerar cada resposta. É lento, propenso a erros, e cognitivamente cansativo⁴.

Estes exemplos são GenUI na sua forma mais primitiva, e já fazem uma diferença real. Não por serem tecnologicamente avançados, mas porque aplicam princípios clássicos de design de interação (reduzir carga cognitiva, minimizar fricção, prevenir erros) de forma dinâmica e contextual.

De designer de interfaces a designer de constraints

Se a interface é gerada pela IA, o que faz o designer? A resposta é concreta: passas a desenhar outcomes e constraints, não componentes individuais.

Outcome-oriented design significa orquestrar a experiência com foco nos objetivos do utilizador e nos resultados finais, automatizando aspetos da interação e do design da interface³. Constraints são as regras que a IA tem de cumprir quando gera uma interface. Que informação é obrigatória mostrar? Que ações nunca devem ser permitidas? Que padrões de interação são aceitáveis para cada tipo de utilizador?

Vamos ao caso prático da Delta Airlines que um artigo da NN/g descreve³. Imagina uma utilizadora chamada Alex que abre a app para reservar um voo para Chicago. A Alex tem dislexia, documentada no seu perfil. A app usa uma fonte e contraste adaptados. A Alex fala com o agente de IA da Delta, pede voos para Chicago de 6 a 10 de maio. Como não especificou aeroporto de origem, o sistema assume o habitual (Miami). Enquanto procura voos, verifica eventos e meteorologia. Aparece um aviso: há um grande evento nessas datas, os preços vão subir.

Os resultados são organizados com base nas preferências da Alex: custo e duração em destaque, porque é o que ela mais valoriza. O primeiro voo seria ideal, mas tem um aviso: não há lugares à janela. A Alex gosta sempre de janela. Passa ao seguinte. Voos noturnos? Colapsados no fundo da lista. A Alex nunca os escolhe.

Cada um destes comportamentos é um constraint que alguém definiu. Não é a IA a inventar regras. É um designer (ou uma equipa) a definir: "para utilizadores com dislexia, aplicar estas regras de acessibilidade"; "priorizar resultados por custo e duração quando o histórico indica essas preferências"; "categorizar informação em deve mostrar, pode mostrar, nunca mostrar."

Este exemplo individual pode ser possível sem GenUI. Mas fazê-lo para 190 milhões de passageiros por ano? Isso só é possível com interfaces geradas em tempo real por IA, dentro de constraints definidas por humanos.

Queres aprofundar como desenhar experiências e interações com inteligência artificial? Na TheStarter temos um curso online, ao vivo e em inglês sobre isso mesmo: Human-Centered AI Experiences (HAX). Fazemos várias turmas por ano. Inscreve-te!

Designers para humanos, designers para máquinas

Há uma segunda mudança a acontecer em paralelo que poucos designers estão a acompanhar. E é, em muitos aspetos, mais urgente do que a GenUI.

Hoje, usamos agentes de IA para interagir com sistemas em nosso nome. Pedimos ao ChatGPT para pesquisar informação, ao Claude para analisar documentos, a agentes especializados para marcar reuniões, processar dados, preencher formulários. Damos comandos, guardrails, e a IA executa. Agentes de IA estão a tornar-se participantes ativos nos ecossistemas que desenhamos. Interagem com sistemas em nosso nome, tomam decisões, e executam tarefas⁵.

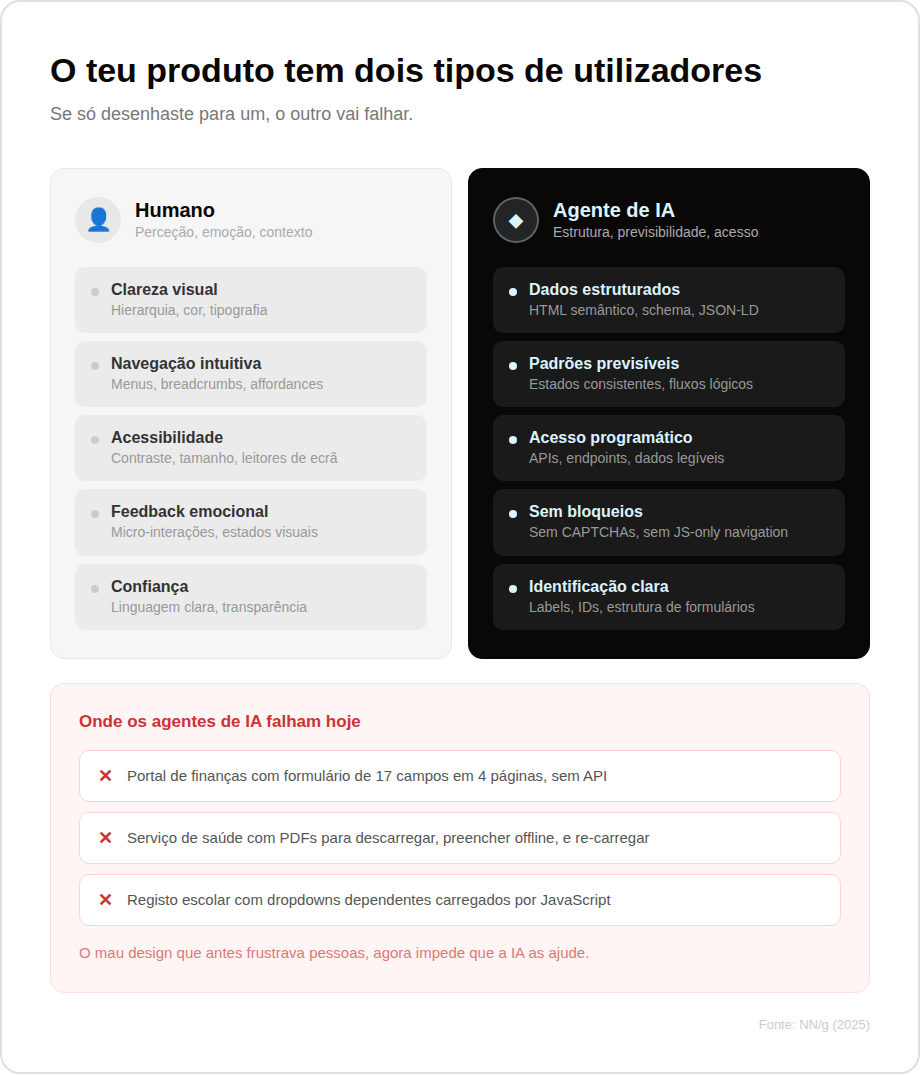

O conceito chama-se designing for a dual audience: utilizadores humanos e os seus representantes de IA. Para humanos, o design prioriza clareza, acessibilidade, facilidade de navegação. Para agentes de IA, o design precisa de priorizar dados estruturados, padrões de interação previsíveis, e acesso programático⁵.

Agora, a pergunta prática: quantos dos sistemas que usamos todos os dias estão preparados para isso?

Formulários de 17 passos: quando a IA esbarra no mundo real

Imagina que pedes a um agente de IA para renovar o teu cartão de cidadão, tratar da declaração de IRS, ou inscrever o teu filho numa escola pública. O agente vai a um portal governamental e encontra: um formulário de 17 campos dividido em 4 páginas, sem API, com CAPTCHAs, menus dropdown que dependem de seleções anteriores carregadas por JavaScript, e PDFs que precisam de ser descarregados, preenchidos offline, e re-carregados.

Este cenário não é hipotético. É a realidade de milhões de interações com serviços públicos e sistemas legacy, não só em Portugal, mas em todo o mundo. Um benchmark recente de investigadores do Center for AI Safety e da Scale AI mostrou que agentes de IA baseados em GPT-4 têm taxas de sucesso baixas em tarefas reais na web que exigem navegação, preenchimento de formulários, e recuperação de informação⁶.

O problema não é a inteligência do agente. O problema é que estes sistemas foram desenhados exclusivamente para utilizadores humanos. E muitas vezes, mal desenhados até para eles. Formulários governamentais confusos são um problema de UX antigo. Mas agora, esse mau design tem um custo adicional: impede que a IA ajude as pessoas que mais precisam de ajuda.

Na prática, vão emergir dois tipos de agentes: assistentes pessoais independentes que atuam como coordenadores em múltiplos serviços, e agentes criados por organizações para interfacer com clientes⁷. Ambos precisam de sistemas desenhados para serem legíveis por máquinas, não apenas por humanos.

Isto significa que Product Designers e equipas de produto precisam de começar a perguntar: como é que um agente de IA vai interagir com o que estou a desenhar? O meu formulário tem uma estrutura semântica legível? Os meus fluxos têm estados previsíveis? A minha API é acessível para interações programáticas?

Se a resposta é "não pensámos nisso", tens trabalho para fazer.

O que não muda (e isso é uma boa notícia)

Pode parecer que tudo está a mudar ao mesmo tempo. Mas há uma boa notícia: muitas das competências fundamentais dos designers vão tornar-se mais relevantes, não menos³.

Resolução de problemas centrada no utilizador. Pensamento crítico. Curiosidade. Uma perspetiva holística. Research. Estas competências não perdem valor num mundo de GenUI e Agentes. Ganham. Porque quando a interface é gerada automaticamente, a qualidade do resultado depende inteiramente da qualidade das regras, dos constraints, e do conhecimento sobre os utilizadores que alimentam o sistema.

Se não sabes quem são os teus utilizadores, os teus constraints vão ser genéricos. Se não fizeres research, os outcomes que defines vão ser os errados. Se não tiveres pensamento sistémico, os teus guardrails vão ter falhas que nenhuma IA consegue compensar.

Research, Behavioural Design, Vieses Cognitivos, vão tornar-se ainda mais centrais no design de experiências. Estudar utilizadores vai ser cada vez mais necessário à medida que princípios de design tradicionais são desafiados e o comportamento dos utilizadores muda. Testar vai garantir que as interfaces geradas dinamicamente satisfazem de facto necessidades diversas³.

Se queres reforçar a tua prática de research, na TheStarter temos o curso UX Research: Métodos de Impacto e Valor, focado em métodos que produzem resultados acionáveis, não relatórios que ninguém lê.

Craft e estratégia: complementos, não opostos

Há uma tentação perigosa nesta conversa: concluir que, se a IA gera interfaces, o craft de design visual e de interação perde relevância. Não perde.

O que está a acontecer é uma redistribuição. Execução genérica de UI, o tipo de layout que qualquer ferramenta de IA já produz, está a perder valor. Mas craft intencional (decisões de micro-interação informadas por research, hierarquias visuais que comunicam estados complexos, padrões de acessibilidade bem implementados) continua a ser um diferenciador forte.

No exemplo das checkboxes do Google AI Mode, alguém teve de decidir que checkboxes eram o padrão certo para aquele contexto. Alguém teve de definir como os itens selecionados apareciam no campo de input. Alguém teve de garantir que a transição entre seleção e continuação da conversa era fluida. Isso é craft. E é isso que faz a diferença entre uma GenUI que funciona e uma que frustra.

Os exemplos atuais de GenUI funcionam precisamente porque têm guardrails rígidos sobre o design gerado⁴. No Claude, por exemplo, limita-se a quatro perguntas no máximo. Sem essa regra, o modelo poderia decidir fazer 35 perguntas seguidas. Constraint design é, em si, uma forma de craft. Talvez a mais difícil de todas, porque é invisível quando funciona bem.

O que podes começar a aprender hoje

Não precisas de esperar que a GenUI seja mainstream para começar a preparar-te. Aqui ficam competências concretas que já fazem diferença:

Pensamento em sistemas e regras, não em ecrãs. Quando desenhares o próximo fluxo, experimenta documentar não apenas o layout, mas as regras que o governam. Que informação aparece para cada tipo de utilizador? Que ações são bloqueadas? Que estados são possíveis? Estás a praticar constraint design.

Research mais profunda, com mais segmentos. Se GenUI permite personalizar interfaces por utilizador, precisas de perceber a variabilidade real dos teus utilizadores. Personas genéricas não chegam. Customer journeys com detalhe sobre contextos, limitações, e preferências tornam-se o input direto para os constraints que defines.

Noções de dados estruturados e APIs. Não precisas de te tornar developer. Mas precisas de perceber como os sistemas comunicam entre si, o que é uma API, e como a informação no teu design pode ser estruturada para ser legível tanto por humanos como por máquinas. Isto é particularmente relevante para quem trabalha em serviços públicos, saúde, ou serviços financeiros.

Acessibilidade como prática, não como checklist. Num mundo onde interfaces se adaptam ao utilizador, a acessibilidade deixa de ser uma lista de requisitos mínimos e passa a ser parte da lógica que alimenta o sistema. Saber desenhar para necessidades diversas torna-se parte do constraint design.

Literacia em IA. Não precisas de saber treinar modelos. Mas precisas de perceber como funcionam, onde falham, e como os outputs variam. A literacia em IA não é uma escala simples: compreensão, confiança, e uso eficaz variam muito entre profissionais⁸.

Na TheStarter, temos um programa desenhado para quem quer juntar design e IA de forma prática: o curso UX para Inteligência Artificial. Abordamos os fundamentos de IA que um designer precisa de saber, sem assumir background técnico. E para quem quer praticar, o Vibe Coding para Product Designers e PMs é uma forma de começar a construir com IA sem ser developer.

O que estás a desenhar?

A GenUI não é ficção científica. Checkboxes em AI chats já existem. Agentes de IA já tentam usar os sistemas que tu desenhaste, e muitas vezes falham.

A questão já não é se estas mudanças vão acontecer. A questão é se tu estás a preparar-te para elas.

Quando desenhaste o teu último formulário, pensaste em como um agente de IA o navegaria? Quando definiste o fluxo de um produto, documentaste as regras que o governam, ou apenas os ecrãs finais? Quando fizeste research, investigaste a variabilidade real dos teus utilizadores? Ou contentaste-te com uma persona genérica que cabe num post-it?

O designer que só sabe fazer ecrãs bonitos tem os dias contados. Não porque o craft seja irrelevante (não é), mas porque o craft sozinho, sem pensamento sistémico, sem capacidade de definir constraints, sem literacia de IA, é insuficiente para os produtos que já estão a ser construídos.

O ecrã deixou de ser o produto. O sistema de regras por trás dele é que é.

A pergunta é: estás a desenhá-lo?

Referências

¹ Nielsen, J. (2024). AI: First New UI Paradigm in 60 Years. Nielsen Norman Group.

² Idem.

³ Moran, K. & Gibbons, S. (2024). Generative UI and Outcome-Oriented Design. Nielsen Norman Group.

⁴ Moran, K. (2026). The Most Exciting Development in GenUI: Buttons and Checkboxes. Nielsen Norman Group.

⁵ Fernández Vallejo, P. (2025). Redefine Your Design Skills to Prepare for AI. Nielsen Norman Group.

⁶ Federal News Network (2025). Why AI Agents Won't Replace Government Workers Anytime Soon. Referência ao benchmark do Center for AI Safety e Scale AI.

⁷ Gibbons, S. (2025). How Service Design Will Evolve with AI Agents. Nielsen Norman Group.

⁸ Nielsen Norman Group (2025-2026). Vários artigos sobre AI literacy e AI-changing search behaviors. Disponíveis em nngroup.com/topic/ai.